Le "nouveau Google" dérape

Et aussi: Waymo rattrapé par la patrouille - OpenAI lance un comité sur la sécurité

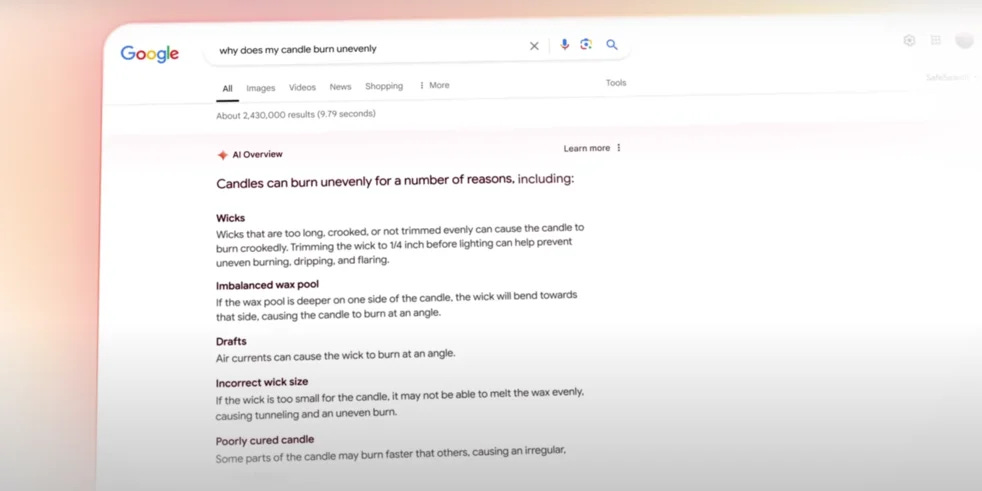

Pourquoi la fonctionnalité d'IA de Google multiplie les erreurs

Ajouter de la colle à la sauce pour éviter que le fromage ne coule de la pizza. Ou encore manger un caillou par jour pour un apport en minéraux et en vitamines. Voilà deux suggestions loufoques faites par… Google. Ou plutôt par la nouvelle fonctionnalité d’intelligence artificielle générative intégrée depuis mi-mai au moteur de recherche – pour le moment, seulement aux États-Unis. Ces réponses ne sont que deux exemples parmi tant d’autres, partagés depuis des jours par les internautes. Certes, ces multiples erreurs ne diffèrent pas vraiment de celles que peuvent écrire d’autres services d’IA, comme ChatGPT. Mais elles pourraient avoir un impact bien plus grand, en raison de la taille de Google, qui capte plus de 90% des recherches en ligne. Avec le risque, pour le moteur, d’une perte de confiance des internautes.

“AI Overview” – Face à ce danger, le géant de Mountain View avait décidé de prendre son temps avant d’ajouter des réponses fournies par l’IA sur sa page de résultats, contrairement à Microsoft. Les rumeurs autour du lancement d’un outil de recherche par OpenAI, le concepteur de ChatGPT, ont certainement accéléré son calendrier. Tout comme le succès de la start-up Perplexity AI. Désormais, Google va afficher, pour certaines recherches, un module baptisé “AI Overview”, au-dessus des traditionnels liens et extraits de site Internet. Celui-ci est alimenté par Gemini, le grand modèle de langage développé en interne. Pour limiter les erreurs et faire remonter des informations pertinentes, le moteur met en avant sa base de données de plus de “1.000 milliards de faits” et son “incomparable système de classement”.

La faute de Reddit ? – Les erreurs des IA génératives, appelées hallucinations, sont inhérentes à leur fonctionnement: les modèles ne font que prédire leur réponse. Des méthodes existent pour les limiter, en particulier la génération augmentée par récupération (RAG), qui permet de se baser uniquement sur une base de connaissance réputée fiable. Sur Google, celle-ci est constituée des pages Internet considérées comme pertinentes – en s’appuyant probablement sur leur popularité. Et des 16 milliards de messages postés sur Reddit, à qui la société va verser près de 200 millions de dollars sur trois ans. Mais l’IA ne sait toujours pas distinguer ce qui est vrai de ce qui est faux. Le conseil sur la pizza provient ainsi d’une blague faite sur Reddit. Celui sur les cailloux d’un article publié par le site parodique The Onion.

Erreurs passées inaperçues – Pour sa défense, Google répond que les erreurs qui circulent ces derniers jours correspondent à “des requêtes peu communes”, qui ne sont pas “représentatives”. Au-delà des réponses loufoques, qui sont clairement identifiables et qui peuvent faire sourire, combien d’erreurs passent inaperçues ? Combien de réponses contiennent des éléments de désinformation ? Une personne qui pose une question ne connaît généralement pas la réponse. Et n’a donc aucun moyen de savoir si les affirmations de Gemini, ou de ChatGPT, sont correctes. Or, Google est réputé comme une source fiable d’information, que les internautes ne remettent pas souvent en doute. La société en a d’ailleurs bien conscience: elle n’affiche pas de réponse générée par l’IA pour les sujets considérés comme sensibles, comme la santé.

Pour aller plus loin:

– Avec l’aide de Microsoft, OpenAI veut concurrencer Google

– Perplexity AI, la start-up qui veut “ringardiser Google”

Les voitures autonomes de Google rattrapées, à leur tour, par la patrouille

Fin 2023, Waymo se félicitait de la sûreté de ses voitures autonomes. Six mois plus tard pourtant, la filiale de Google est visée par une enquête préliminaire de la sécurité routière américaine, la NHTSA. Celle-ci a recensé 31 incidents: des violations du code de la route ou des accidents mineurs n’impliquant pas d’autres véhicules et n’ayant pas fait de blessé. La société dispose de deux semaines pour fournir les vidéos filmées par ses voitures. Cette instruction n’est pas une première: la NHTSA enquête aussi sur le système d’aide à la conduite de Tesla, sur Cruise, la filiale de General Motors qui a suspendu ses essais après une collision avec une piétonne, et sur Zoox, une start-up rachetée en 2020 par Amazon. Elle illustre les difficultés du secteur à franchir un cap décisif pour un déploiement à plus grande échelle.

Robots-taxis – Lancé dès 2009 comme un moonshot au sein du laboratoire Google X, Waymo est considéré comme l’acteur le plus avancé dans le domaine de la conduite autonome. L’entreprise a déjà lancé son service de robots-taxis à San Francisco, Los Angeles et Phoenix. Elle espère l’étendre prochainement à Austin. Elle réalise désormais 50.000 trajets payants par semaine, principalement en centre-ville mais pas encore sur les autoroutes – même si elle a récemment reçu une autorisation à San Francisco et mène des tests à Phoenix. Fin 2023, Waymo revendiquait 11,5 millions de kilomètres parcourus sans la présence d’un opérateur à bord pour reprendre le contrôle en cas de besoin, pour seulement trois accidents ayant causé des blessures mineures. Un taux sept fois inférieur à la conduite humaine, assurait alors la société.

Circulation à contresens – Dans deux documents publiés ces deux dernières semaines, la NHTSA met cependant en lumière d’autres incidents, moins graves, qui nuancent le bon bilan dressé par Waymo. Seulement une partie d’entre eux ont été à l’origine de rapports officiels envoyés à la sécurité routière. Les autres ont été identifiés par des “informations publiques”, à savoir des vidéos publiées en ligne par d’autres usagers de la route. Par exemple: une voiture qui circule à contresens sur des voies à sens unique, une autre qui roule du mauvais côté de la route ou une autre qui se retrouve au milieu d’une zone de travaux. La NHTSA évoque également des “collisions avec des objets clairement visibles qu’un conducteur compétent est censé éviter”, comme des chaînes, des barrières et des véhicules en stationnement.

Marge d’erreur – Si le nombre d’incidents reste limité, surtout comparé à ceux provoqués par des conducteurs, l’enquête de la NHTSA témoigne de la faible acceptation sociale des voitures autonomes. La technologie ne peut ainsi pas se permettre de marge d’erreur. Un véritable défi qui demande d’accumuler les kilomètres en conditions réelles pour récolter une multitude de données permettant d’améliorer les algorithmes au cœur du système. Depuis quinze ans, d’importants progrès ont certes été réalisés. Mais à un rythme probablement moins rapide qu’espéré. Surtout, la dernière ligne droite est la plus difficile. “Concevoir une machine capable d’avoir raison 99% du temps est relativement facile. Parvenir à un taux de 99,9999%, le niveau qu’il faut atteindre, est beaucoup plus difficile”, résumait il y a quelques années Tesla.

Pour aller plus loin:

– Cruise reprend les essais de ses voitures autonomes… avec des conducteurs

– Apple abandonne son projet de voiture électrique autonome

OpenAI se dote d'un nouveau comité chargé de la sécurité de l'IA

Une semaine après la suppression de sa principale équipe de recherche travaillant sur la sécurité, OpenAI a annoncé mardi la création d’un nouveau comité dans le domaine. Avec deux différences de taille: celui-ci ne sera que temporaire. Et il sera dirigé par Sam Altman, le patron du concepteur de ChatGPT, accusé par d’anciens employés de privilégier le développement rapide de l’intelligence artificielle générative, sans se soucier des risques. Ce comité aura pour mission d’évaluer les garde-fous mis en place par la start-up, dirigée donc par… Sam Altman. Puis, de proposer des recommandations au conseil d’administration, au sein duquel siège… Sam Altman. Mardi, dans une tribune publiée dans The Economist, deux anciennes membres du conseil, qui avaient tenté d’évincer le dirigeant en novembre, appellent les gouvernements à intervenir avant qu’il ne soit trop tard. “D’après notre expérience, l’autorégulation ne peut pas résister de manière fiable à la pression des profits”, écrivent-elles.

Pour aller plus loin:

– La face cachée d’OpenAI, rattrapé par de multiples polémiques

– Le double discours d’OpenAI sur la régulation de l’IA

Crédit photos: Google - Waymo