La volte-face de Nvidia sur l'inférence

Et aussi: Hausses de prix pour les smartphones

Nvidia opère un virage stratégique avec sa première puce dédiée à l’inférence

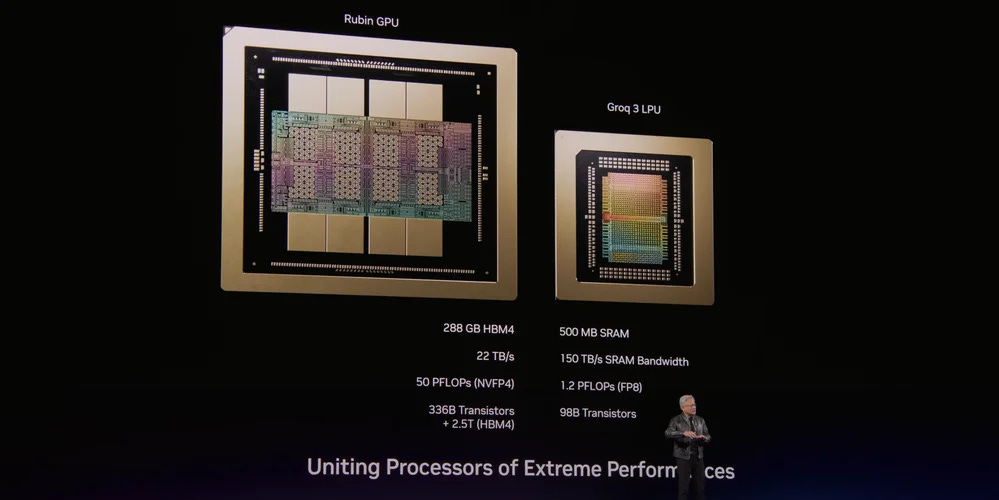

Jensen Huang est habitué à dicter le tempo sur le marché des puces dédiées à l’intelligence artificielle générative. Le patron de Nvidia vient pourtant de s’adapter à une évolution alimentée par ses concurrents. Lundi, en ouverture de la GTC, la grande conférence annuelle organisée par le groupe de Santa Clara, il a dévoilé un accélérateur spécifiquement conçu pour l’inférence, c’est-à-dire la phase d’exécution des modèles d’IA pour générer textes, images ou vidéos. Combiné à la dernière génération de cartes graphiques (GPU) maison, celui-ci permet de “repousser les limites” avance-t-il.

Baptisée Groq 3, cette puce, dont le lancement est prévu au troisième trimestre, est la première issue de l’acquisition déguisée de l’entreprise éponyme, conclue fin décembre pour un montant estimé à 20 milliards de dollars. Elle marque un revirement stratégique de la part de Nvidia, qui proposait jusqu’à présent la même architecture de cartes graphiques pour l’entraînement et l’inférence. Ce choix a laissé le champ libre à de nouveaux acteurs, qui misent sur des composants pensés pour l’exécution des modèles d’IA, promettant des gains de vitesse et une réduction des coûts.

Puces spécialisées

Groq faisait partie de ces acteurs. Fondée en 2016 par d’anciens ingénieurs de Google ayant participé à la conception du premier TPU, la puce d’IA du moteur de recherche, la société est longtemps restée dans l’anonymat. À plusieurs reprises, elle a même frôlé la faillite. Profitant de l’essor de l’IA générative, elle s’est positionnée sur le marché de l’inférence avec des puces spécialisées, baptisées LPU (unité de traitement du langage). Avant d’être absorbée par Nvidia, elle faisait miroiter une vitesse d’exécution dix fois supérieure et une consommation d’énergie divisée par dix.

Officiellement, Groq n’a pas été rachetée. Les deux entreprises ont seulement signé un“accord de licence non exclusif”, permettant au géant des GPU de mettre la main sur ses technologies et sur ses équipes d’ingénieurs – environ 90% des employés, dont le fondateur et patron Jonathan Ross, travaillent désormais pour Nvidia. Cette structure inhabituelle est un subterfuge popularisé l’an passé par Microsoft. Elle permet d’échapper à un feu vert préalable des autorités de la concurrence – une longue procédure qui aurait pu déboucher sur un veto ou sur des cessions d’actifs imposées.

“Point d’inflexion”

Cet accord symbolise une prise de conscience chez Nvidia: la demande pour des puces exclusivement dédiées à l’inférence, qui nécessite moins de puissance que l’entraînement, est en forte croissance, en particulier pour réduire les investissements et les coûts d’exploitation. En septembre, le groupe avait déjà présenté un GPU spécialement conçu pour cette tâche. Ce modèle reposait toutefois encore sur une architecture similaire à celle de ses autres accélérateurs, utilisant notamment sur des mémoires HBM, et non sur des mémoires SRAM, réputées comme mieux adaptées.

Longtemps reléguée au second plan, l’inférence est désormais cruciale. “Nous avons atteint un point d’inflexion”, souligne Jensen Huang. Le déploiement rapide des outils de code informatique et l’essor attendu de l’IA agentique devraient en effet décupler les capacités nécessaires à l’exécution des modèles. Cette phase pourrait ainsi représenter une part croissante de la structure de coûts, renforçant d’autant la nécessité d’optimisation. L’an passé, OpenAI et Anthropic n’ont d’ailleurs pas atteint leurs objectifs de marge en raison de coûts d’inférence plus élevés que prévu.

Double menace

S’il occupe une position quasi monopolistique sur les GPU utilisés pour l’entraînement des modèles, Nvidia est en revanche attaqué de toutes parts sur le marché de l’inférence. La menace est double. D’un côté, des fabricants spécialisés comme Cerebras ou Sambanova proposent des puces plus performantes, qui ont déjà séduit des clients prestigieux, comme OpenAI et Meta. De l’autre, les concepteurs de modèles IA et les plateformes du cloud s’appuient de plus en plus sur leur propre accélérateur pour l’inférence, substituant ainsi une partie de leurs achats auprès de Nvidia.

Une troisième menace se profile. Selon The Information, Google souhaite désormais vendre ses TPU, jusqu’à présent exclusivement déployés dans ses propres data centers, pour ses besoins internes et ceux des clients de son offre de cloud. Meta pourrait être l’un des premiers acheteurs, intégrant les puces de son rival dans ses infrastructures à partir de 2027. Les dirigeants du moteur de recherche estimeraient pouvoir capter 10% du marché. Pas de quoi nécessairement inquiéter Jensen Huang, qui table sur un chiffre d’affaires de 1.000 milliards de dollars entre 2026 et 2027.

Pour aller plus loin:

– La demande pour les GPU de Nvidia ne faiblit pas

– Avec ses derniers modèles d’IA, Google démontre ses progrès dans les puces

PARTENAIRE

La tech ne doit plus être un risque, mais un levier de performance

La transformation digitale n’est plus un projet ponctuel, mais une réalité permanente. Pour y faire face, CBTW lance TechAAA: une approche structurée pour aligner organisation, processus et stack technologique avec vos objectifs business.

Tech AAA repose sur trois piliers: Assessment (audit de l’existant), Analyse (définition de la cible) et Activation (plan d’action concret, du As-Is au To-Be). Objectif: bâtir un socle technologique robuste, agile et pensé pour la croissance, sans créer de dette ni de dépendance.

Déjà adoptée par des entreprises en forte croissance, cette méthode permet d’éviter les remises à plat coûteuses tous les cinq ans et de faire de la tech un véritable moteur de performance.

Vous souhaitez en savoir plus sur Tech AAA ?

📘 Téléchargez le guide des dirigeants pour reprendre le contrôle de la stratégie, des opérations et de l’IT

💬 Lire l’interview de Maximilien de Coster, Leader Partner Strategy, Product & Transformation

L’IA entraîne de premières hausses de prix sur le marché des smartphones

Le mouvement reste limité, mais il est désormais enclenché. La semaine dernière, les fabricants chinois de smartphones Vivo, Oppo et OnePlus sont devenus les premiers à officialiser une hausse des prix pour certains modèles déjà commercialisés. Pour l’heure limitée à la Chine, la mesure est justifiée par l’envolée du coût des puces mémoire, portée par la demande liée à l’intelligence artificielle générative. Selon les analystes, le phénomène devrait s’étendre, en particulier sur le segment de l’entrée de gamme, où les marges étaient déjà très réduites.

“L’équation pour des smartphones à moins de 100 dollars ne tient plus”, souligne Nabila Popal, analyste chez IDC. Environ 170 millions d’appareils vendus par an pourraient ainsi disparaître de manière “permanente”. Face à cette situation, le cabinet se montre très pessimiste pour le marché des smartphones. Il anticipe une chute historique de 12,9% des ventes cette année, avec seulement 1,1 milliard d’unités écoulées, le plus bas niveau depuis 2013. En décembre, il ne redoutait qu’un repli limité à 5%. IDC prévoit dans le même temps un bond de 14% du prix de vente moyen.

Pénurie de puces mémoire

À l’origine de ce bouleversement: le développement effréné des infrastructures dédiées à l’IA. Cette puissance de calcul supplémentaire ne nécessite pas seulement des cartes graphiques, mais aussi de la mémoire, notamment des puces à large bande passante (HBM). Pour répondre à cette demande exponentielle, les trois géants du secteur – les coréens SK Hynix et Samsung, et l’américain Micron – ont réorienté une partie de leurs lignes de production vers ces composants plus lucratifs, au détriment des mémoires DRAM et NAND destinées aux smartphones, PC et consoles de jeux.

La demande pour l’IA “absorbe une telle part de la capacité disponible que cela crée une pénurie sans précédent pour les autres segments de l’industrie”, reconnaît un responsable de Micron, interrogé par Bloomberg. Les carnets de commandes des trois fabricants sont ainsi déjà remplis pour 2026. Selon le cabinet TrendForce, 70% de la production de mémoires est désormais dédiée à l’IA. Conséquence: les tarifs des autres composants s’envolent. Au quatrième trimestre 2025, le prix des puces DRAM a augmenté de 45% à 50%, et il devrait encore grimper de 55% à 60% au premier trimestre.

Le centre de gravité s’est déplacé

SK Hynix, Samsung et Micron n’avaient pas anticipé une demande aussi massive. Pire encore, les trois entreprises ont sous-investi ces dernières années, après la crise de surproduction qui a frappé le secteur à partir de 2023. Si elles prévoient désormais d’augmenter leurs capacités, leurs nouvelles lignes de production ne seront pas opérationnelles avant 2027 ou 2028. Et rien ne garantit qu’elles ne soient pas consacrées principalement, voire intégralement, aux mémoires pour l’IA. Sans compter l’émergence de nouveaux produits, comme les robots, qui nécessiteront eux aussi des mémoires.

Le secteur des puces mémoire est coutumier des cycles, alternant régulièrement entre épisodes de pénurie et de surproduction. Mais cette fois, le basculement semble plus profond: le centre de gravité de l’industrie s’est déplacé. Ce ne sont plus les mémoires destinées aux smartphones et ordinateurs qui dictent le tempo des fabricants, mais celles dédiées aux datas centers. Dans ces conditions, la crise actuelle pourrait s’inscrire dans la durée, au moins tant que l’euphorie autour de l’IA persistera. “L’époque du silicium à bas coût est terminée”, résume Carl Pei, fondateur de la marque Nothing.

“Réinitialisation structurelle du marché”

“Si les prix de la mémoire devraient se stabiliser d’ici la mi‑2027, il est peu probable qu’ils retrouvent leurs niveaux antérieurs”, confirme Nabila Popal. L’enjeu est considérable: ces puces représentaient historiquement entre 15% et 20% du coût des composants des modèles de milieu de gamme, et entre 10% et 15% pour les modèles haut de gamme. Pour l’instant, l’impact reste limité sur le marché des smartphones, car les grandes marques peuvent encore s’appuyer sur leurs stocks et sur des contrats précédemment signés à prix fixes. Mais ce répit commence déjà à toucher à sa fin.

Les fabricants vont devoir arbitrer entre une hausse des prix, une contraction de leurs marges ou une limitation – voire une dégradation – des caractéristiques techniques. Chacune de ces options présente des limites. La première se répercutera sur la demande, la seconde semble surtout accessible au segment premium, et la troisième n’encouragera pas les consommateurs à changer de smartphone. Dans ce contexte, “la crise ne provoquera pas seulement une baisse passagère des ventes, elle marque une réinitialisation structurelle du marché”, estime Nabila Popal.

Pour aller plus loin:

– L’IA et la pénurie de puces mémoire font bondir les profits de Samsung et SK Hynix

– Pourquoi Apple ne souffre pas (encore ?) de son retard dans l’IA

Crédit photos: Nvidia - Vivo